Per la Pubblica amministrazione serve un’intelligenza artificiale certificata secondo norme Iso

Viviamo un’epoca in cui i sistemi di intelligenza artificiale e machine learning possono contribuire a migliorare profondamente l'efficienza delle pubbliche amministrazioni. L'adozione responsabile di queste tecnologie può rendere l'azione amministrativa più rapida, efficace, predittiva, persino empatica nella gestione dei servizi. Ma tutto questo potenziale non può e non deve offuscare i rischi, spesso latenti, che si annidano nell’adozione non regolamentata o opaca di questi strumenti.

Non possiamo permettere che algoritmi non verificati, addestrati su dati distorti o privi di controllo, decidano le sorti di cittadini e imprese. L’intelligenza artificiale deve essere uno strumento al servizio dell’uomo, e mai il contrario.

Per questo, propongo che in tutti i contratti pubblici venga inserito l’obbligo di certificazione dei fornitori di sistemi e modelli di intelligenza artificiale, secondo standard riconosciuti a livello internazionale. Il riferimento non può che essere la recente norma ISO/IEC 42001, che costituisce il primo sistema globale di gestione dell’intelligenza artificiale. Essa attesta che i sistemi siano sviluppati e utilizzati in modo etico, trasparente, affidabile, responsabile.

Ma certificare un sistema significa anche certificare chi lo certifica. Ecco perché è necessario che tale attestazione sia rilasciata da organismi accreditati secondo lo standard ISO/IEC 17021-1: una garanzia di imparzialità, competenza e coerenza. Solo così potremo assicurare che i sistemi di intelligenza artificiale introdotti nella PA – e, auspicabilmente, anche nel settore privato – rispettino i principi fondamentali di equità, non discriminazione, protezione della privacy e sicurezza dell’utente.

la trasparenza degli algoritmi non è solo una questione tecnica. È una questione democratica. Come ha giustamente osservato il professor Luciano Floridi, stiamo assistendo a un fenomeno chiamato “pareidolia semantica”: attribuiamo significato, coscienza, intenzione ai sistemi artificiali, dimenticando che dietro quei processi non ci sono emozioni, ma semplici correlazioni statistiche. Il rischio è quello di delegare decisioni etiche, giudizi sociali, perfino relazioni umane a sistemi che non hanno alcuna consapevolezza.

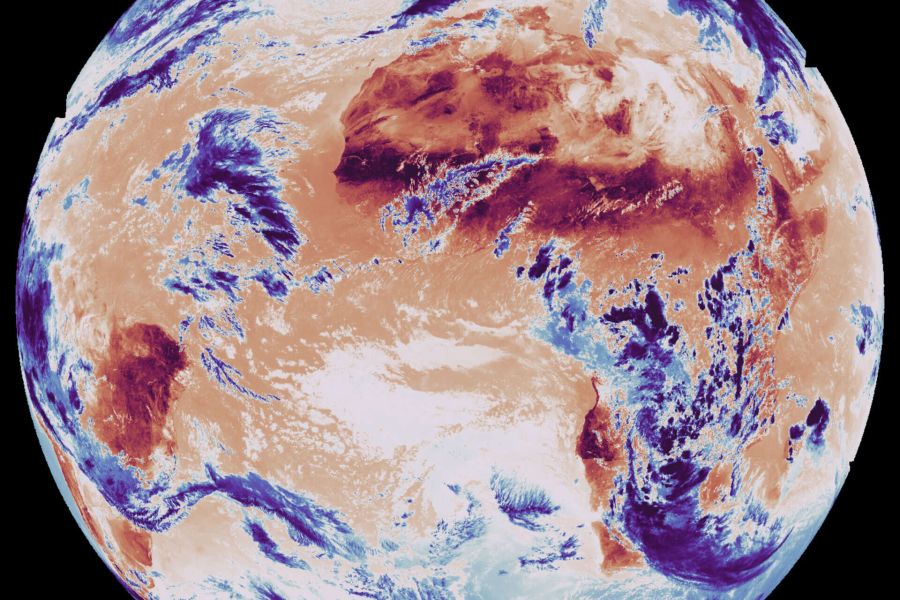

Eppure i benefici sono concreti. Sistemi di intelligenza artificiale responsabili possono supportare la diagnosi precoce nelle strutture sanitarie pubbliche, ottimizzare i flussi di mobilità urbana, monitorare la qualità dell’aria, prevedere eventi climatici estremi. Possono persino aiutare nella transizione ecologica.

Ma senza fiducia, non c'è progresso. E la fiducia si costruisce solo con regole certe, certificazioni chiare e governance robusta. La crescita dei dati mobili, la diffusione dei social network, l’uso massivo di AI nei contenuti digitali e nella pubblicità devono spingerci a una riflessione: la tecnologia va normata, prima che normi noi.

L’Italia ha tutte le competenze per giocare un ruolo di leadership etica e industriale in questo campo. Lo dimostra il successo della nostra industria farmaceutica, che ha saputo coniugare innovazione e affidabilità, o i dati sul crescente interesse giovanile verso l’informazione online, che va guidato e non abbandonato al caos degli algoritmi commerciali.

La certificazione dei sistemi di intelligenza artificiale non è un vincolo, è una tutela. Non è una zavorra burocratica, è un presidio di civiltà.

La storia ci insegna che ogni grande potere tecnico richiede un altrettanto grande senso di responsabilità politica. Questo Parlamento ha l’onore e il dovere di scrivere una pagina nuova, che non rincorra la tecnologia, ma la indirizzi, la governi, la metta al servizio della persona e del bene comune.

Diamo forma a un futuro digitale che non sia solo più veloce, ma anche giusto.